A mesterséges intelligencia nem tud felelősséget vállalni a tetteiért, mégis fegyverekbe építenék

A Google a héten bejelentette, hogy frissítette a mesterséges intelligencia (AI) fejlesztésére vonatkozó etikai irányelveit, amelyek között már nem szerepel az a korábbi tétel, miszerint a vállalat nem használja fel a technológiát fegyverekben és polgári megfigyelőrendszerekben. A vállalat AI-vezére, a tavaly Nobel-díjjal kitüntetett Demis Hassabis ezt a változó világ új kihívásaival magyarázta, ahol nagyobb szerep jut a nemzetbiztonságnak. Az irányelv eltörlése a Google-nek egy mozdulat volt, de a következményei beláthatatlanok: ha a világ egyik legnagyobb techcége nem áll ki az etikus AI-felhasználás mellett, akkor a kisebb halak még kevésbé lesznek elkötelezettek aziránt, hogy megállítsák technológiájuk katonai felhasználását.

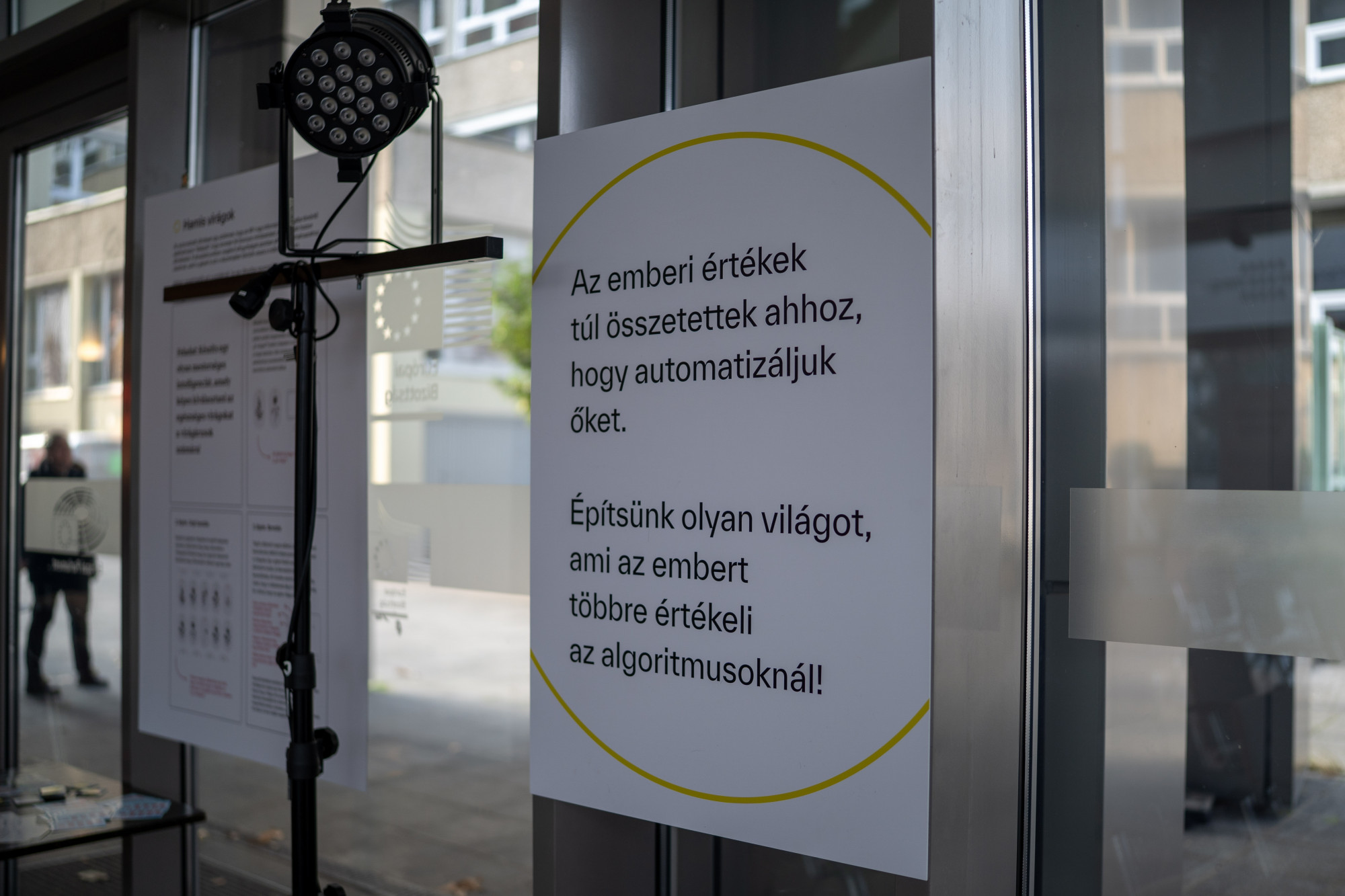

De szabad-e, vagy egyáltalán lehet-e ekkora felelősséget hárítani, akár élet-halál döntés bízni olyan algoritmusokra, amelyek bár minden embert egyenlően kezelnek azáltal, hogy csupán 0-knak és 1-eknek látják őket, de nincs meg a képességük az emberi erkölcsi mérlegelésre? És mi köze az autonóm fegyverrendszereknek ahhoz, hogy mára elfogadtuk, az internet ingyenes szegmenseiben az adatainkkal fizetünk, és a techcégek mindent tudnak rólunk? Ezeket járja körül az Embertelen tervezés – Digitális dehumanizáció című kiállítás, amely február 26-ig látogatható a budapesti Európa Pontban, a Millenárison.

A február 7-én, pénteken megnyílt tárlatot a Stop Killer Robots (Állítsuk meg a Gyilkos Robotokat) kampány aktivistái, Bíró Dalma és Katona Illés hozták el Magyarországra – az esemény előtt őket faggattuk a technológia és az emberi jogok legégetőbb kérdéseiről.

A megnyitót kísérő kerekasztal-beszélgetésen Ződi Zsolt jogász, a Nemzeti Közszolgálati Egyetem kutatója, Vass Norbert, a Nemzeti Adatvédelmi és Információszabadság Hivatal (NAIH) főosztályvezetője, valamint két fiatal AI-jogi szakértő, Lakatos Dániel (Milestone Intézet) és Katona Illés (ELTE ÁJK) fejtette ki még jobban ezt a kérdéskört.

Fotó: Kun Zsuzsi / Qubit

Abban mindenki egyetértett, hogy szabályozásra szükség van, ám arra, hogy azt milyen formában és rendszerben kell megvalósítani, már többféle választ adtak. Bár arról sincs köztük vita, hogy az Európában bevezetett és folyamatosan implementált AI Act egy ígéretes és átfogó szabályozás, de sok esetben nem elégséges – vannak pontok, ahol a sokat támadott uniós adatvédelemi jogszabály, a GDPR sokkal részletesebb. A szakértők szerint be kell látni, hogy ezek a szabályzatok nem önállóan és külön-külön alkalmazandók, hanem együtt, rendszerként érvényesek – és így már hatékonyak tudnak lenni a felhasználók adatainak védelmében.

A kiállítás anyagát az Identity 2.0 nevű, a digitális jogok, a technológia és az identitás határait kutató kreatív stúdió hozta létre, az Amnesty Internationallel és a Soka Gakkai International nevű békeszervezettel együttműködve.