Új megközelítéssel készítették el az eddigi legpontosabb gondolatolvasó készüléket

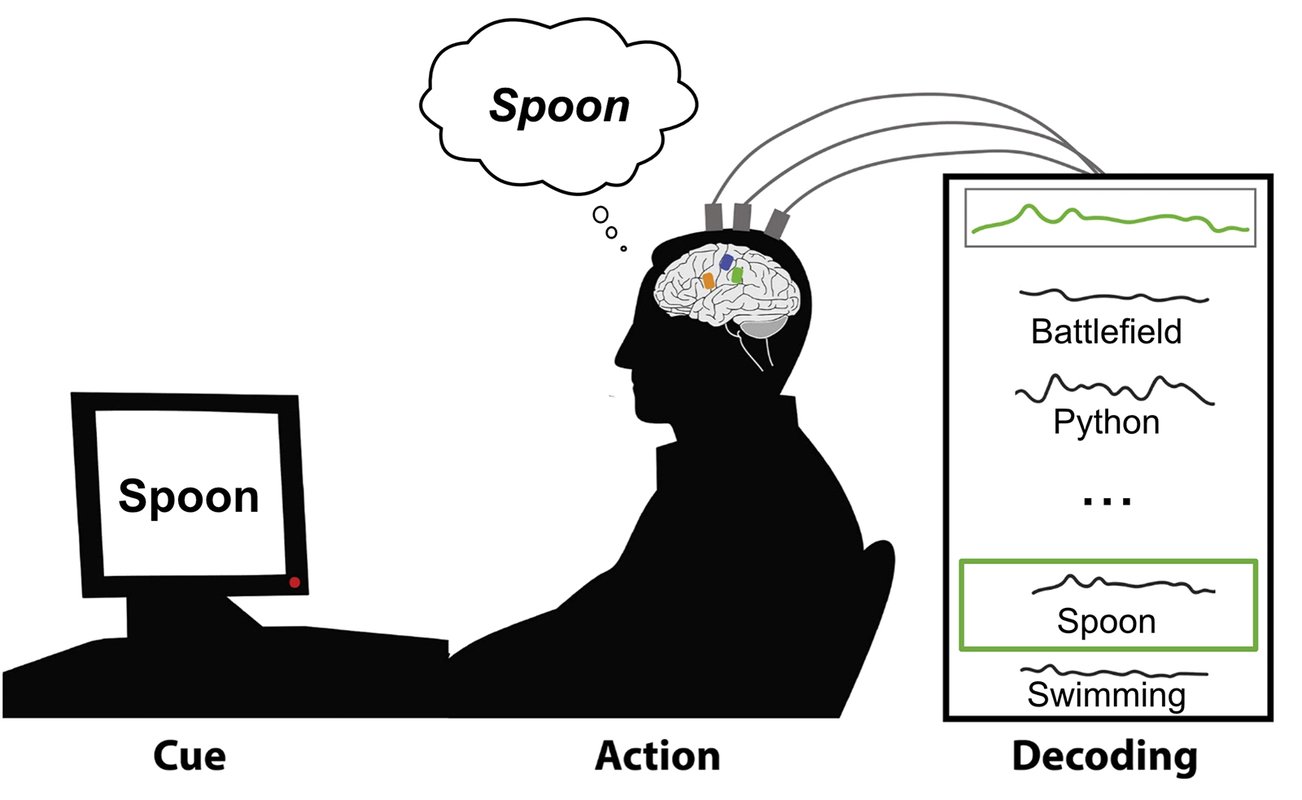

A Kaliforniai Műszaki Egyetem (Caltech) kutatói és mérnökei olyan agyi implantátumok fejlesztéséről adtak hírt, amelyek képesek dekódolni a belső beszédet, vagyis azonosítani azokat a szavakat, amelyeket az ember úgy „mond ki” gondolatban, hogy közben nem mozgatja az ajkait és nem ad ki hangot.

Bár korábban már hallhattunk olyan agy-számítógép interfészekről, amelyek az agyi jeleket szöveggé fordítják, és akár másodpercenként 60-80 szó azonosítására is képesek, ezeket általában olyan beszéd elemzésére tervezték, amely legalább részben artikulált.

A Nature Human Behaviour folyóiratban május 13-án megjelent tanulmányban azonban az első olyan technológiát írták le, amely a teljes mértékben belsőleg „elhangzó” szavak dekódolására képes, az agy egyes neuronjainak jeleit valós időben rögzítve. A tanulmány társszerzője, Sarah Wandelt szerint ez a technológia „különösen hasznos lenne olyan embereknek, akik már egyáltalán nem tudnak mozogni”.

A kutatók két, gerincvelő-sérüléssel küszködő ember agyába ültették be az apró elektródák tömbjeit, amelyeket a szupramarginális gyrusban helyezték el – az agynak egy olyan területén, amit korábban még nem vizsgáltak hasonló, a beszéd dekódolására irányuló kutatásokban. Ezt a döntést azokra a korábbi tanulmányokra alapozták, amelyek szerint az agynak ez a része aktív a szubvokális beszédben (amikor valaki az ajkait, a nyelvét vagy a gégéjét a hangos beszédhez hasonlóan mozgatja, de nem ad ki közben hangot), illetve az olyan feladatokban, mint például annak eldöntése, hogy a szavak rímelnek-e egymásra.

A beültetés után két héttel a kutatók elkezdték az adatgyűjtést: az agy-számítógép interfészt hat szóval (csatamező, cowboy, piton, kanál, úszás, telefon) és két értelmetlen álszóval (nifzig, bindip) tanították be. Mint Wandelt a Nature-nek elmondta, ennek az volt a lényege, hogy kiderüljön, „szükséges-e a jelentés a reprezentációhoz”.

A három napon át tartó kísérletben arra kérték a résztvevőket, hogy képzeljék el, ahogy a képernyőn megjelenő szavakat kiejtik, anélkül, hogy ezt megtennék – ezt a folyamatot aztán minden egyes szó esetében többször megismételték. Az interfész később kombinálta a résztvevők agyi aktivitásának méréseit egy számítógépes modellel, hogy valós időben meg tudja jósolni a két alany belső beszédét. Míg az egyik résztvevő esetében a készülék az összes szóhoz különböző idegi jeleket rögzített, és 79 százalékos pontossággal azonosítani tudta azokat, a másikuknál csak 23 százalékos volt a dekódolás pontossága – nála kevesebb olyan idegsejtet észleltek, amely csak bizonyos szavak esetében volt aktív.

A kutatók szerint az eredmények rávilágíthatnak arra, hogy az emberek milyen különböző módokon dolgozzák fel a belső beszédet, valamint hogy milyen különböző mechanizmusok játszódhatnak le a hangos és a belső beszéd közben – mint megállapították, a belső beszéd során aktív neuronok kb. 85 százaléka akkor is aktív volt, amikor hangosan is kimondták a szavakat, de voltak olyanok is, amelyek csak a belső beszéd során aktivizálódtak.

A belső beszédről azonban még így is keveset tudunk. Például azt sem tudják meghatározni a kutatók, hogy az agy a belső beszédet fonetikusan, tehát hang alapján, vagy esetleg szemantikusan, tehát jelentés alapján reprezentálja. A kutatás következő lépésében arra keresik a választ, hogy az interfész képes-e különbséget tenni az ábécé betűi között (ami a potenciális klinikai használat során a beszédképtelen pácienseknek segíthetne szavak betűzésében), miközben arra is szeretnének rájönni, hogy a kísérletben részt vevő egészséges alanyokon túl működik-e a módszer azoknál, akik elvesztették a beszédképességüket.

Kapcsolódó cikkek a Qubiten: