Az Nvidia bemutatta a világ legerősebb MI-s csipjét

2024. március 19. – 14:31

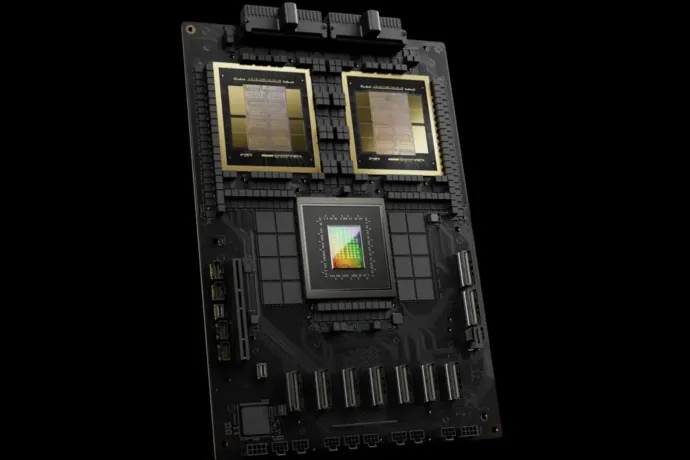

Az Nvidia már most piacvezető a mesterséges intelligenciáknál használt csipek területén, és most bemutatták a legújabb generációt, a Blackwellt – írja a Verge. A generációba egyelőre két csip tartozik, a Blackwell B200 GPU és a GB200-as szupercsip, ami két B200-ast és egy Grace CPU-t foglal magába.

Ezeket a csipeket nagy nyelvi modellek (large language model – LLM) betanítására és működtetésére használják. Már a mostani H100-as csipjük is rengeteget segített a piacvezető pozíció megszerzésében, de a Blackwellek még többet segíthetnek a technológia fejlődésében.

A GB200-assal futtatott LLM-ek a cég szerint 7-30-szor hatékonyabb és jelentősen energiatakarékosabb, mint a H100-as csipeket használók. Egy 1,8 milliárd paraméterű modell betanításához 8000 H100-as csipre és 15 megawattnyi áramra van szükség, de a cég szerint a Blackwell GPU-kból elég 2000 darab és mindössze 4 megawattnyi áram. Egy 175 milliárd paraméteres GPT-3 LLM benchmark teszten a GB200-as hétszer volt hatékonyabb, mint a H100-as, és a cég szerint négyszer gyorsabb betanítást tesz lehetővé.

Emögött többek között az áll, hogy a csipek papíron 20 petaflopnyi FP4-es számítási kapacitással rendelkezik, ami ötször erősebb, mint a H100-as. Ezen persze segít, hogy a valójában két csipet összeillesztő GB200-ason 208 milliárd tranzisztor található, míg a H100-as mindössze 80 milliárdból állt.

Ez persze inkább a vállalati ügyfeleknek izgalmas, ezért például olyan nagy házakban árulják a csipeket, amikbe például 360 CPU-t és 72 GPU-t szuszakoltak bele. Ezt az egészet folyadékkal hűtik, és több mint három kilométernyi kábel tekertek bele. Ettől függetlenül a technológia később valószínűleg megjelenik majd a videójátékokhoz készített videókártyákban is.